贝盈网

贝盈网

微软Windows应用科学副总裁Vivek Pradeep于周一(6/23)发布博客文章,披露一款专为Copilot+ PC所设计的小型语言模型Mu。这是一个可于设备端执行的模型,目前主要应用在Windows系统中的“设置代理人”功能,协助用户通过自然语言调整数百项系统设置。该功能目前仅开放给Dev频道中、使用Copilot+ PC的Windows Insiders测试者试用。

微软于2024年5月正式发布主打AI应用的Copilot+ PC,采用基于Arm架构的系统单芯片,并集成神经处理单元(NPU),要求其NPU运算性能至少达到每秒40兆次操作(40 TOPS)。包括Surface、ASUS、HP、Lenovo、Dell、Acer等品牌皆已推出Copilot+ PC。然而截至2025年第一季,这类产品在整体PC市场中的市场占有率仍不到5%贝盈网,距离普及尚有一段距离。

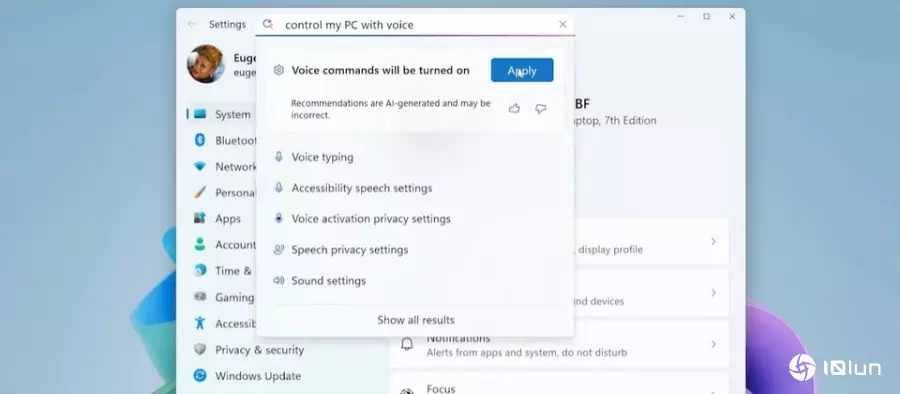

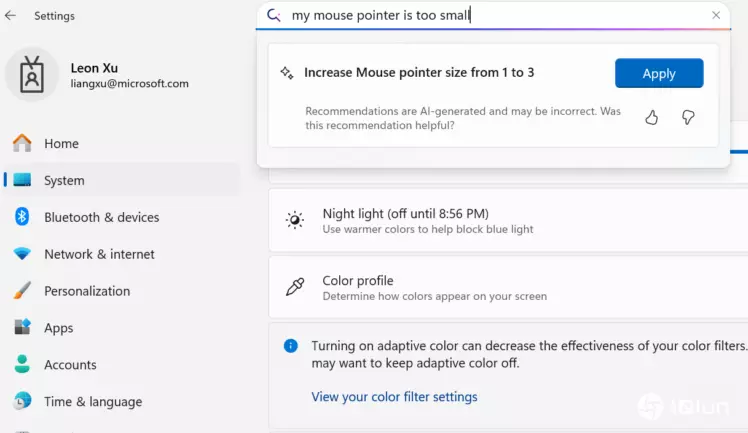

Mu模型正是专为这类具备NPU的设备所打造,可完全于本机执行,推理速度超过每秒100个token。这也是微软首度将语言模型应用于设备端,并聚焦于“Windows设置代理人”的角色。用户只需输入像是“打开飞行模式”、“提高屏幕亮度”、“关闭自动更新”等自然语言,就能触发对应设置操作。不过目前仅支持文本输入,尚未直接支持语音。

贝盈网

贝盈网

图片来源/微软

Pradeep表示,Mu是在微软开发Phi系列模型的基础上重新设计,从零开始打造、专为资源受限的NPU设备优化。其核心采用Transformer的Encoder–Decoder架构,能先全面理解输入内容,再产生精准输出,运算效率更高。

为了发挥设备端性能,微软针对Mu的模型尺寸与参数分配做出精细调整,例如将2/3的参数配置给编码器、1/3配给解码器,并采用输入/输出权重共享以节省内存。同时,Mu仅使用NPU完全支持的运算操作,确保每次推理都能以最高效率执行。

在训练过程上,Mu先以数千亿个高品质教育数据进行预训练,再通过Phi模型进行知识蒸馏,最后以LoRA微调技术针对特定任务强化模型表现。即便模型体积仅为Phi-3.5-mini的十分之一,Mu在标准任务(如SQuAD问答与CodeXGlue程序任务)上的表现仍与Phi相当接近。

在部署阶段,微软应用了后训练量化(PTQ)技术,将模型从浮点格式转为整数表示,进一步压缩体积并降低计算负担。加上与Qualcomm、Intel、AMD等芯片厂的合作优化,Mu在如Surface Laptop 7等Copilot+ PC设备上,推理速度可达每秒200个token。

Pradeep补充,目前Mu仅应用于Windows设置代理人,并已针对此任务使用约360万笔样本进行微调,涵盖数百项系统设置。模型也根据输入语句的长度与明确程度调整回应方式,例如输入“亮度”这类短语时会回传传统搜索结果贝盈网,而输入“提高主要屏幕亮度”这类具体语句,才会由Mu代理人执行具体设置动作,以兼顾准确度与使用体验。

有富策略配资提示:文章来自网络,不代表本站观点。